Искусственный интеллект уже умеет анализировать поведение человека точнее, чем это делает большинство людей. Однако назвать его «детектором лжи» пока нельзя: технологии фиксируют косвенные признаки, а не сам факт обмана, сообщает El.kz.

Что ИИ действительно умеет

Современные системы на базе нейросетей, включая методы из области машинного обучения, способны замечать детали, которые человек не различает.

Алгоритмы анализируют микродвижения лица, улавливая изменения длительностью всего несколько десятков миллисекунд. Также технологии могут бесконтактно оценивать физиологические параметры - например, частоту пульса по изменениям цвета кожи.

Отдельное направление - анализ речи. ИИ фиксирует дрожание голоса, нестандартные паузы и изменения тембра, которые могут сигнализировать о внутреннем напряжении.

Насколько это точно

Исследования последних лет показывают, что человек распознаёт ложь почти на уровне случайности - примерно в половине случаев.

ИИ в лабораторных условиях демонстрирует более высокие показатели - от 60 до 85 процентов. В отдельных экспериментах заявляется точность выше, но такие результаты пока не считаются универсальными.

При этом учёные отмечают важную особенность: алгоритмы часто склонны «перестраховываться» и чаще интерпретируют поведение как ложь.

В чём главная проблема

Ключевое ограничение в том, что ИИ распознаёт не ложь как таковую, а признаки стресса.

Человек может нервничать по разным причинам - из-за давления, страха или самой ситуации проверки. Это приводит к ошибочным выводам.

Добавляется и культурный фактор. Жесты, мимика и поведение сильно различаются в разных странах, а алгоритмы не всегда корректно это учитывают.

Почему есть ограничения

Использование таких технологий уже вызывает дискуссии в правовой и этической плоскости. В ряде стран их применение в судах или при приёме на работу ограничено из-за риска ошибок и дискриминации.

Ошибка системы в таких ситуациях может повлиять на судьбу человека, поэтому требования к точности остаются крайне высокими.

Что это значит на практике

Сегодня ИИ можно рассматривать как вспомогательный инструмент для анализа поведения. Он помогает выявлять подозрительные сигналы, но не даёт окончательных выводов.

Решение по-прежнему остаётся за человеком. Именно он интерпретирует данные, учитывая контекст, мотивацию и обстоятельства.

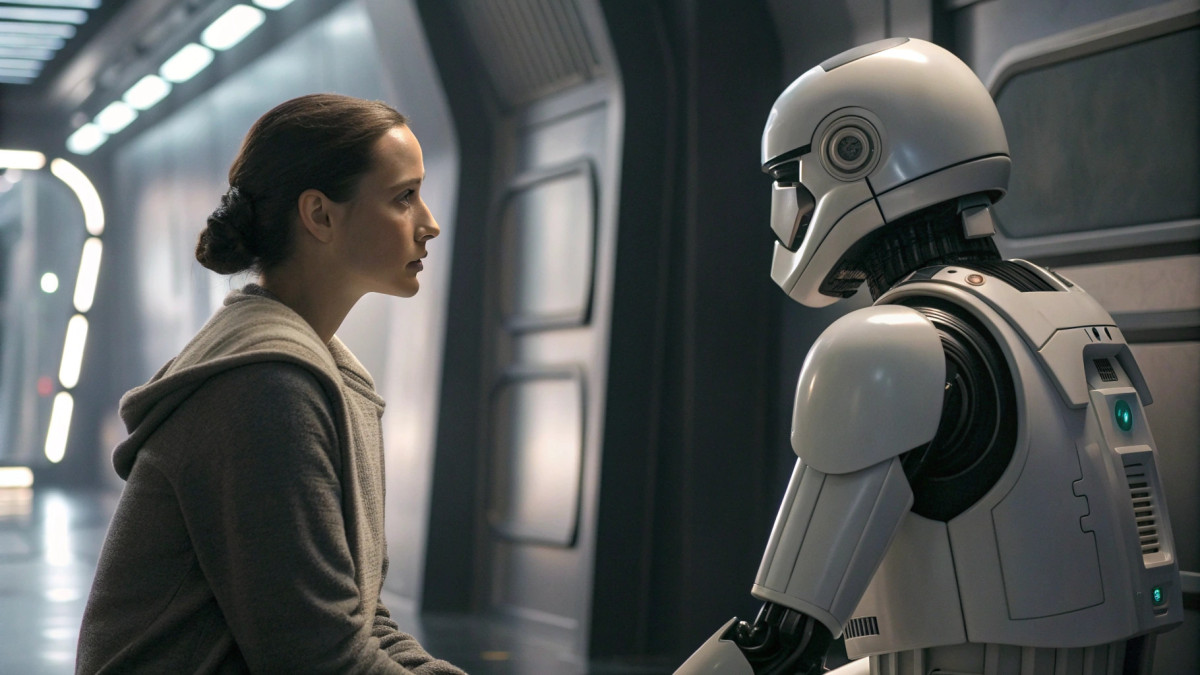

Ранее мы рассказали про фильм, который начал сбываться в эпоху ИИ: как создают генетически совершенных людей