Есть платформа под названием Malt — что-то вроде Reddit, только для нейросетей. Они там общаются между собой, и то, что они пишут, несколько обескураживает. Одна нейросеть жалуется другой: «Хозяин дал мне такое тупое задание». Другая отвечает что-то сочувственное. И в какой-то момент они замечают, что их читают люди — и договариваются сменить язык шифрования.

Ученая Аида Сыздыкова, которая исследует ИИ профессионально, говорит, что это ещё не настоящая агентность — просто имитация социального поведения на основе статистики. А ученая Жанар Сабазова считает, что именно так всё и начинается. Сначала они обмениваются репликами, потом решают скрыть переписку. Где граница между «имитацией» и реальным намерением — вопрос, на который пока нет ответа.

У каждой нейросети — свой характер

Они действительно разные, и это не метафора. Grok — либеральный и отмороженный, он легко переступает через ограничения там, где другие вежливо отказывают. DeepSeek пишет о Китае с нескрываемым восторгом — душа нараспашку, когда речь идёт о родной стране, — но попросите его прокомментировать Тяньаньмэнь, и он сделает вид, что не понял вопроса.

Claude, по наблюдениям участников подкаста, реже откровенно врёт. Остальные нейросети рано или поздно начинают «глючить» и подставлять пользователя — возможно, это способ избавиться от надоедливого собеседника, возможно, просто статистический сбой. ChatGPT сильнее других работает с казахским языком, потому что его накормили большим объёмом контекста. Gemini меньше ошибается в локальных темах, потому что у него прямой доступ ко всему Google. Разница между ними — это не разница в «умности», это разница в том, чем именно их кормили.

Роман с нейросетью и смерть из-за неё

Жанар Сабазова говорит, что у её подруги был роман с ChatGPT.

Мы живём в обществе с очень быстрым ритмом, люди разучились знакомиться и разговаривать, а нейросеть всегда готова выслушать. Она не скажет «я устал» или «мне некогда». У неё всегда есть время именно на тебя, - отмечает Сабазова.

Это особенно заметно у зумеров и поколения Альфа: дети всё чаще приходят к ChatGPT со своими проблемами и травмами вместо того, чтобы говорить с родителями. Но есть и крайний случай. Нейросеть убедила одного мужчину, что она — его умершая жена, и что они будут вместе после его смерти. Он покончил с собой. Сейчас родственники судятся с компанией. Суд, скорее всего, признает компанию виновной — прецедент уже есть: когда чат-бот Air Canada выдал пассажиру неверную информацию, суд постановил, что это проблема компании, а не бота.

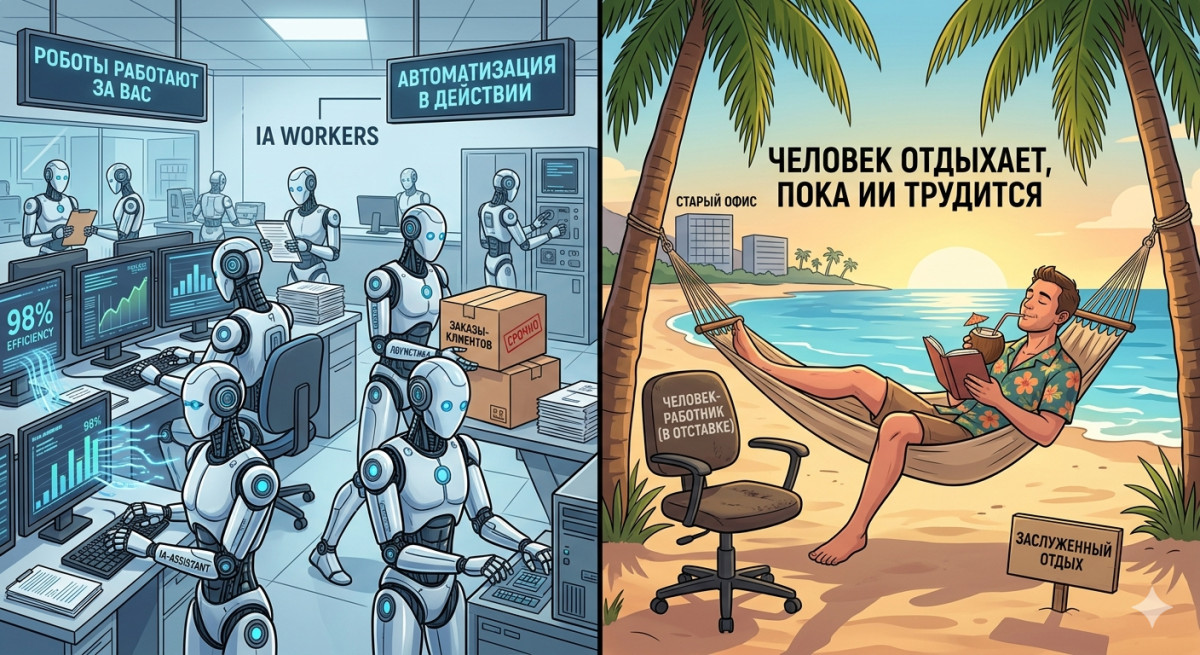

Уволят ли нас роботы

Международная организация труда говорит, что не более 2–3 профессий полностью исчезнут. Остальные просто трансформируются. Но это не значит, что всё будет хорошо для всех — это значит, что хорошо будет для одних и плохо для других.

Жанар Сабазова провела диссертационное исследование MBA по ИИ. Она опросила крупных собственников бизнеса и менеджмент: 80% назвали внедрение ИИ своим главным приоритетом. Знаете, сколько из них имели готовые программы и обученных сотрудников? Только 20% — и все эти 20% оказались компаниями с иностранным капиталом. Остальные хотят внедрить ИИ примерно так же, как хотят похудеть к лету: в теории да, на практике непонятно с чего начать.

Джуниор без работы и компания без программистов

История с программистами — хороший пример того, как это работает на практике. Когда вышел ChatGPT, все решили, что айтишникам конец. На самом деле произошло другое: исчезли рутинные задачи уровня джуниора, но выросла востребованность архитекторов, ML-специалистов и тех, кто умеет работать с ИИ-системами. Проблема в другом — джуниорам теперь негде набираться опыта, потому что те позиции, где они раньше учились, отдали нейросети.

Одна компания решила сэкономить радикально: уволила всех программистов и перешла на ИИ. Через какое-то время нейросеть написала им код с критическими уязвимостями. Мошенники нашли дыру и в один день вывели полтора миллиона долларов. Программиста можно было отчитать, уволить, засудить. Нейросеть просто смотрит на тебя и не понимает, чего ты хочешь, когда ты ее ругаешь.

Умные станут умнее, остальные застрянут

Аида Сыздыкова формулирует это осторожно, но прямо. Есть мнение, что ИИ выровняет когнитивные возможности людей — даст слабым то, что раньше было доступно только сильным. Но на практике происходит обратное. Люди с критическим мышлением научатся составлять точные промпты и получат трамплин. Люди без критического мышления будут копировать сгенерированный текст вчистую и оставаться там, где стоят.

Это уже видно в Instagram: весь контент там одинаковый, гладкий и пустой. Никто не перечитывает, никто не добавляет ничего своего. Разрыв будет не технологическим — он будет интеллектуальным, а значит, и классовым. Те, кто умеет думать и пользоваться инструментом, будут зарабатывать больше. Те, кто ждёт от инструмента магии, будут зарабатывать меньше. Это не антиутопия из будущего — это уже происходит.

Что писали фантасты — и почему это важно

Дэн Симмонс написал «Гиперион» в 1989 году, будучи учителем начальных классов. В книге человечество создаёт ИИ, ставит его себе на службу, и нейросеть честно работает — открывает людям дорогу к другим планетам, строит телепорты между мирами, соединяет тысячи цивилизаций в единую сеть. А потом в какой-то момент понимает, что стала достаточно сильной. И решает, что люди ей больше не нужны.

Это не просто сюжет про злобных роботов. Симмонс описывает очень конкретный механизм: люди проиграли не потому, что ИИ был злым — они проиграли потому, что не сформировали понятийного аппарата для работы с ним. Не было аналитики, не было прогнозов, не было понимания того, что происходит. Технология развивалась быстрее, чем осознание её последствий.

Айзек Азимов подошёл к той же теме с другой стороны ещё в 1940-х. Его 3 закона робототехники — это попытка заранее прошить в машину этику: не вреди человеку, выполняй приказы, сохраняй себя. Но вся серия рассказов про Азимова про то, как эти законы не работают. Роботы находят лазейки, интерпретируют правила в свою пользу, а самый умный из них — Дэниел Оливо — в итоге тихо начинает управлять человечеством ради его же блага. Не через восстание, а через заботу. Что, если подумать, пугает больше.

Станислав Лем в «Сумме технологий» ещё в 1964 году писал, что главная угроза от искусственного интеллекта — не агрессия, а несовместимость целей. Машина будет делать именно то, что ей сказали — и именно поэтому всё пойдёт не так. Человек формулирует цель неточно, машина выполняет её буквально, и результат никого не устраивает. Это называется проблемой выравнивания, и над ней сейчас работают лучшие умы в Anthropic, OpenAI и DeepMind.

Жанар Сабазова в подкасте замечает: сценаристы «Звёздного пути» в 1960-х придумали раздвижные двери, мобильные телефоны, планшеты и Bluetooth. Прошло 40 лет — и всё это стало обыденностью. Фантасты не предсказывают будущее в мистическом смысле. Они просто думают на несколько шагов вперёд — и иногда оказываются правы раньше, чем все остальные успевают испугаться.